达观数据与华南师范大学计算机学院副院长、教授、博士生导师黄震华团队联合科研攻关,在人工智能领域的知识蒸馏方向取得重要学术突破,于国际顶级学术期刊《IEEE Transactions on Neural Networks and Learning Systems》(IEEE TNNLS)发表题为《Fine-Grained Learning Behavior-Oriented Knowledge Distillation for Graph Neural Networks》(面向细粒度学习行为的图神经网络知识蒸馏)的高水平论文,彰显了达观数据在图神经网络与知识蒸馏交叉领域的深厚技术积淀与前沿研究实力。

论文核心思路解读

随着深度学习在图数据处理中的广泛应用, 图神经网络(Graph Neural Network, GNN)已成为解决节点分类、图分类和链接预测等任务的主流方法。然而,深层GNN模型通常面临计算资源消耗大、推理速度慢等问题,限制了其在资源受限环境中的应用。

为了解决这一问题,知识蒸馏(Knowledge Distillation, KD)作为一种有效的模型压缩技术被引入到图神经网络中。通过将大型教师模型的知识迁移到较小的学生模型中,KD不仅能够获得一个轻量级模型,还能在一定程度上提升该模型的性能。这推动了图知识蒸馏领域的快速发展,涌现出多种创新方法。

例如,部分研究人员分别将对抗性思想引入图知识蒸馏中,以增强学生模型的学习效果。此外,部分研究人员则通过引入强化学习机制,设计了动态知识传递策略,进一步提升了学生模型的适应性和泛化能力。

然而,在当前的学习框架中,主要训练学生吸收粗粒度的静态知识,这为学生提供了高度抽象的信息,阻碍了他们对特定任务的深入理解,并影响了他们的学习效率。此外,教师和学生之间传递的静态知识会带来了两个问题:

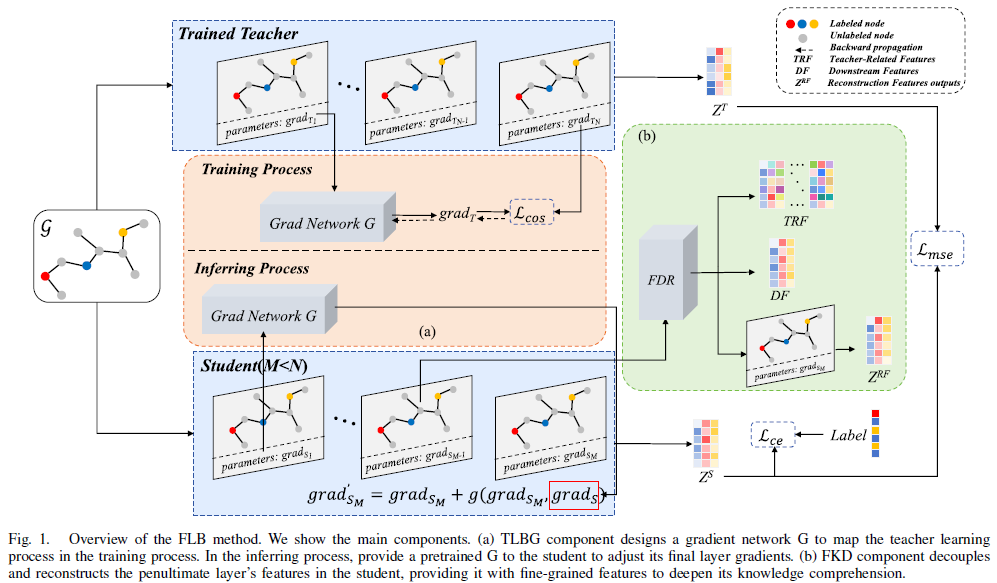

为了解决这些问题,本工作提出了一种面向细粒度学习行为导向(Fine-grained Learning Behavior-oriented, FLB)的方法,如图1所示。

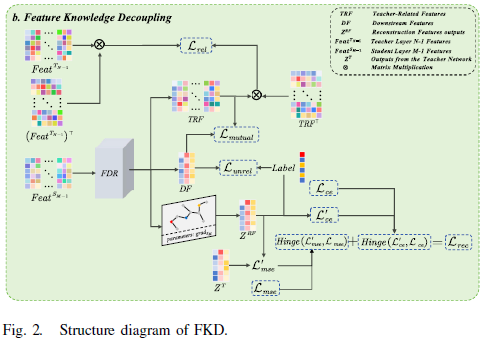

FLB旨在加深学生的知识理解,更加关注教师的学习行为。它包含两个关键组成部分:特征知识解耦(Feature Knowledge Decoupling, FKD)和教师学习行为指导(Teacher Learning Behavior Guidance, TLBG)。在KD 中,知识包括来自输出层的基于逻辑的知识和来自中间层的基于信息丰富的特征的知识。FKD 模块(图2)更侧重于处理基于特征的知识。具体来说,它将学生的特征知识解耦为教师相关特征(Teacher-Related Features, TRF)和下游特征(Downstream Features, DF)。TRF 更注重向教师学习,而DF则侧重于从下游任务标签中学习。同时,在设计中保持TRF 和DF 的相互独立,避免干扰。

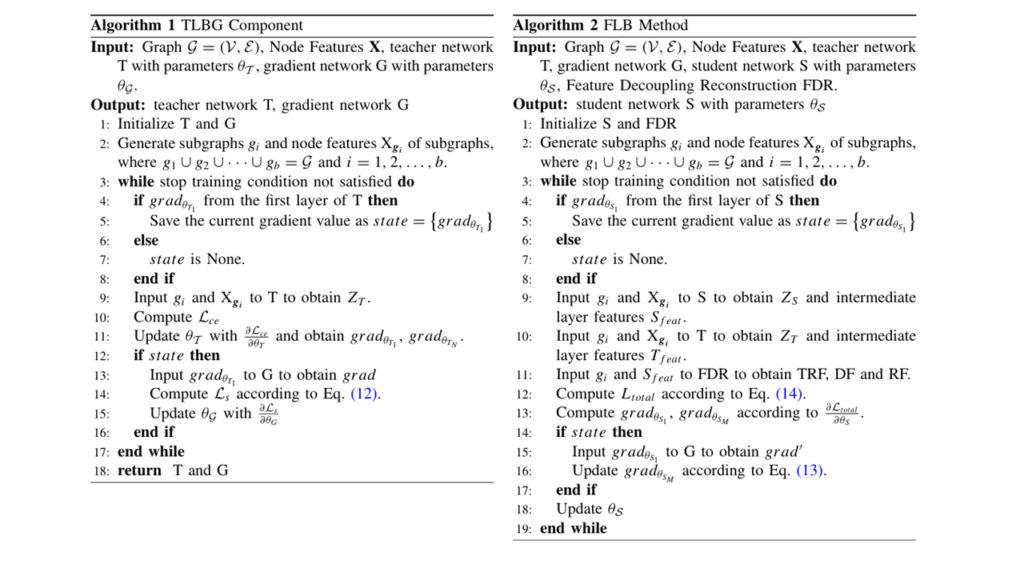

为清晰呈现上述方法的完整执行逻辑,本文分别给出 TLBG 梯度学习器组件与 FLB 整体方法的算法伪代码,如图3所示。

图3 FLB 方法核心算法伪代码

(左:TLBG 梯度学习器组件;右:FLB 整体蒸馏框架)

算法1详细描述了 TLBG 梯度学习器的训练流程:通过初始化教师网络与梯度网络,在迭代训练中捕获教师模型首层梯度状态,将梯度作为动态学习行为输入梯度网络,最终完成梯度学习器的优化;算法2则完整呈现了FLB方法的端到端蒸馏流程,涵盖学生网络初始化、特征解耦重构、总损失计算与梯度引导更新的全链路,直观体现了 “特征解耦+行为引导” 的核心设计。

在8个基准图数据集上(Cora、Citeseer、Pubmed、CS、Photo、Cornell、Texas和Chameleon)进行的广泛实验,包括模型压缩与模型增强场景下的对比实验、消融分析以及超参数敏感性测试,均表明FLB方法不仅能显著提升学生模型的节点分类精度,还在计算效率与模型鲁棒性方面展现出优越性能,证明了该方法在解决图知识蒸馏现存问题上的有效性与潜力。

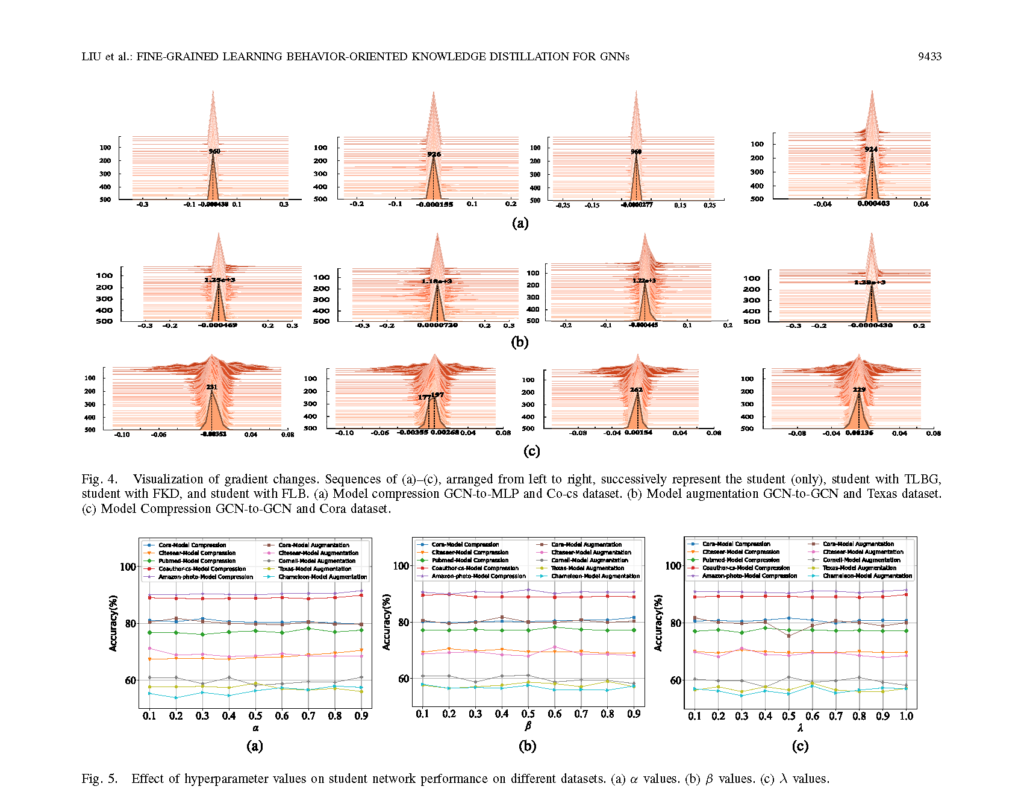

为进一步直观验证方法的核心优势,本文从梯度行为可视化与超参数敏感性两个维度开展分析,结果如下图4 所示。

图4 FLB 方法效果验证(上:梯度变化可视化;下:超参数敏感性实验)

上半部分的梯度变化可视化结果清晰表明:相较于仅训练学生模型、仅加入 FKD 的方案,引入 TLBG 后的学生模型梯度分布与教师模型高度一致,验证了 TLBG 对教师学习行为的精准迁移能力;下半部分的超参数敏感性实验则显示,在 α、β、λ 等关键超参数的宽范围取值下,FLB 方法的模型精度始终保持稳定,证明了方法的鲁棒性与工程落地的易用性。

作者在8个数据集上,针对12种主流蒸馏框架进行了广泛测试 。

●性能提升:实验结果显示,将FLB集成到现有的GNN蒸馏框架(如KD、LSP、GraphAKD等)中,能显著提升学生模型在节点分类任务中的准确率(Acc)、AUC值和F1分数 。

●模型压缩:在“GCN到GCN”以及“GCN到MLP”等多种压缩场景下,FLB均表现出更强的鲁棒性 。

●消融实验:验证了FKD和TLBG两个组件各自的有效性,证明了细粒度知识与动态行为引导对于提升蒸馏效率的必要性 。

总结

该论文的贡献在于从“静态知识传递”转向“动态行为引导”。通过FKD对特征进行精细化解耦,以及TLBG对学习行为进行梯度级别的修正,FLB成功地让轻量级的学生模型更高效地掌握了老师模型的复杂能力,为GNN在资源受限设备上的部署提供了更优的解决方案 。

《IEEE Transactions on Neural Networks and Learning Systems》是IEEE计算智能学会旗下的权威期刊,被SCIE数据库收录,属于中科院SCI 1区TOP期刊,在计算机科学、人工智能、电气电子工程等多个学科领域均位列Q1分区,以严苛的审稿标准和深厚的学术积淀著称,其发表的成果均代表该领域的前沿研究水平与发展趋势。